本文共 1441 字,大约阅读时间需要 4 分钟。

今年毕设做的就是和极限学习机有关的东西,当时老师让我看一篇表征转换机(ACM)的英文文章,我在文中看到了一句话说是表征转换机是基于极限学习机的,所以我后来的毕设论文就是直接用极限学习机来实现了。

一、表征转换机原理

赵晓辉等将表征转换机用于图像分割,取得了不错的效果,在本文中我们将表征转换机作为一种神经网络来实现分类。

对任一个被采集目标,令和

为在

和

条件下得到的图像。

两幅图像是对该被采集目标的不同表征,我们定义转换机。

在给定采集条件为的表征时,可相应获得采集条件为

时的表征,即

对同一目标在不同采集条件下获得的不同表征图像,在没有获得足够信息的情 况下完美地获取另外一种采集条件下的表征图像是非常困难的。如果我们允许一定误差的存在则可近似获取另一采集条件的对应表征图像。可将式改写为:

式可以理解为估计映射函数

,其中

,

和

,这是一个回归问题并可以使用极限学习机求解,这样得到的映射函数即为表征学习机。

的像素点并不均与

的某一 个像素点

相关。因此,如果我们要通过表征图像

获得

时,只需要提供表征图像

中与

有关的像素点。更详细地说,对表征图像

中的任意像素点,都可以在误差允许的情况下基于表征图像

中与此像素点相关的一组像素点来求解。至此,ACM中的一个回归问题已经转化为

个回归问题。

其中,为表征图像

中需要估计的目标像素点,

为表征图像

中与

相关的一组像素。

二、表征转换机算法的设计

由前一节的介绍,我们知道,表征转换机是一种基于极限学习机(ELM,Extreme Learning Machine)的分类学习算 法。ELM算法是根据最小二乘优化来训练网络的,我们可以通过样本来拟合出非线性函数:

作为映射,而误差反向传播算法每次迭代需要更新,所花费的时间远远低于所容忍的时间。经过前面的网络实验我们知道训练一个单隐藏层反馈神经网络需要耗费许多时间。

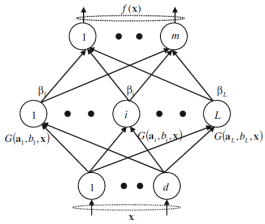

超限学习机网络模型

ELM是一种新型的快速学习算法,它最早由黄广斌教授提出并对ELM进行了总结。如图所示,ELM可以随机初始化输入权值和阈值并得到相应的隐节点输出,从神经网络的结构来看,超限学习机是一个简单的单层前向神经网络,其包含三层:输入层、隐含层和输出层,隐含层有L个神经元,L远远小于N,输出层输出的向量为m维。

一个有L个隐含层节点的单隐含层神经网络,针对加法型隐含层节点:

其中,为激活函数,

是第i个隐层单元的输入权值,

是第i个隐层单元的偏置,

是第i个隐层单元的输出权值。

为了让输出误差最小:

即和

使:

可以矩阵表示:

隐层节点的输出为H,输出权值为,期望输出为T,那么:

其中,,

接下来,我们定义代价函数:

可以通过最小二乘找到最佳权值(最优权值向量),使得损失函数最小。

只要输入权值和隐层

的阈值被确定(随机地),那么隐层的输出矩阵H就能被唯一的确定了。我们将ACM神经网络转化为求解这么一个线性系统:

。然后确定输出来找到这个最佳权值:

是矩阵H的逆矩阵(广义,Moore−Penrose),范数最小且唯一。

与BP通过梯度下降法反复迭代来更新所有层之间的权值不同的地方在于,ELM并不调整单隐含层神经网络的输入层和隐含层的权值,我们随机设定它的权值(注重于隐含层到输出层的权值选取,采用最小二乘),所以ELM的训练速度远远快于BP神经网络。

ELM算法表示如下:

- 假设输入给定的训练的样本集

,隐层输出函数

及隐层的节点个数为L;

- 随机的生成隐层节点的参数

;

- 计算出隐层的输出矩阵H(保证H列满秩);

- 输出网络最优权

:

。

转载地址:http://fsaii.baihongyu.com/